Apify Agent Skills — 用對話爬遍 55 個平台的 AI 技能包

「幫我抓台北市評分 4.5 以上的咖啡店,匯出 CSV。」

這句話是中文的,不是程式碼。但只要你電腦裡裝了 Apify Agent Skills,打完送出,AI 就會自動從 55 個平台的 Actor 清單裡挑一個 crawler-google-places、組好 input schema、跑完爬蟲、把結果存成 CSV 丟到你桌面。從頭到尾你沒寫一行 requests.get()。

這套東西的奇怪之處在於——它不是程式庫。

你以為的爬蟲工具 vs 它實際的樣子

過去你要爬 Google Maps 的流程,大概是這樣:打開 Apify Store 挑一個 Actor,研究它的 input schema 要哪些欄位,寫 Python 組 JSON、呼叫 API、輪詢 run status、等結果出來再下載 dataset。光讀文件就要半小時,寫 code 又一小時。

Apify Agent Skills 把這個流程翻過來做。它裝進去後,沒有任何可以 import 的 API——skills/ 目錄下全是 Markdown 檔加幾個 Node.js 輔助腳本。AI 讀了 SKILL.md 以後,自己判斷該跑什麼指令、呼叫哪個 Actor、要問你哪些資訊。

類比一下:傳統爬蟲工具像是「原料 + 食譜」,你要會下廚;Apify Agent Skills 像是「給大廚一張訂單」,AI 是那位大廚,你只負責動嘴。

四個技能各自在幹嘛

| 技能 | 做什麼 | 什麼時候用 |

|---|---|---|

| Ultimate Scraper | 爬資料 | 用現有 55+ 個 Actor 抓社群/地圖/搜尋結果 |

| Actor Development | 從零建 Actor | 想爬的平台 Actor 不存在 |

| Actorization | 改造既有腳本 | 把本機 Python 爬蟲搬上 Apify 雲 |

| Generate Output Schema | 自動產 schema | 分析 Actor 原始碼產生輸出規格 |

最常用的是 Ultimate Scraper,它直接涵蓋 Instagram、Facebook、TikTok、YouTube、Google Maps、Booking、TripAdvisor——大部分你想得到的社群和 POI 平台都在。

Instagram 支援 12 個 Actor(Profile、Post、Comment、Hashtag、Reel、Followers),Facebook 14 個(Page、Post、Review、Group、Event、Ad、Marketplace),TikTok 14 個(Profile、Video、Comment、Hashtag、Sound、Trend)。加總下來,55+ 平台就是這樣堆出來的。

安裝:一行指令搞定

Claude Code 使用者最簡單:

1 | # 新增 marketplace |

前置條件也很單純:Apify 帳號(apify.com 註冊,有免費額度)、API Token(放 .env、記得加 .gitignore)、Node.js 20.6+。

裝完就能用,不需要重啟什麼東西。

兩種觸發方式

這個 plugin 有個設計很聰明:沒有必背的 slash command。

自然語言觸發

在 Claude Code 對話中講到「爬」「抓」「擷取」「scrape」「lead generation」「competitor analysis」這類關鍵字,AI 會自動匹配 apify-ultimate-scraper skill 並啟動 workflow。

1 | 你:幫我爬 Instagram 上 #taipei 的貼文 |

觸發機制不是精確關鍵字比對,是 AI 根據 skill description 做語意匹配。所以你不用背觸發詞,自然講出需求就好。

/create-actor 指令

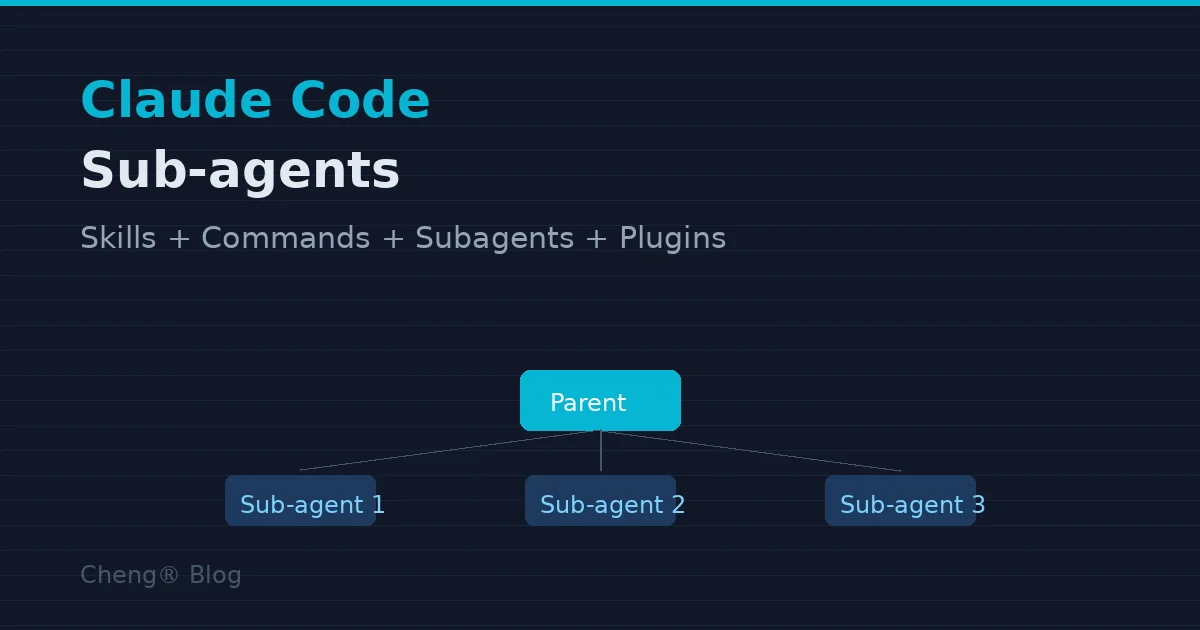

如果現有 55+ Actor 裡沒有你要的平台(例如 Dcard、PTT),就用 /create-actor 啟動 Actor Development 的 10 階段 workflow:

1 | /create-actor 一個爬 PTT 八卦版標題和推文數的 Actor |

AI 會從 Discovery、Setup、選語言、設計架構、實作、測試到部署,一步步引導你建出新的 Apify Actor。

實戰範例

範例 1:自然語言爬咖啡店

1 | 你:幫我抓西雅圖的咖啡店,要名稱、地址、評分,匯出 CSV |

AI 的處理流程:

- 從 55+ Actor 中挑出

compass/crawler-google-places - 自動取得該 Actor 的 input schema

- 問你要幾筆、什麼格式(預設 100 筆,超過 1000 會警告費用)

- 執行爬蟲並匯出 CSV

- 摘要結果,建議後續動作(例如「要不要再串 email 擷取?」)

範例 2:手動跑腳本精確控制

想更精確的話可以直接跑 Node.js 腳本:

1 | node --env-file=.env reference/scripts/run_actor.js \ |

Ultimate Scraper 提供三支輔助腳本:run_actor.js(執行任務)、search_actors.js(找不到 Actor 時搜尋 Apify Store)、fetch_actor_details.js(取得 Actor 的 input schema)。

Markdown 即介面的設計哲學

看一下這個 repo 的結構:

1 | apify/agent-skills/ |

每個 skill 的核心就是一份 SKILL.md——帶 YAML frontmatter 的 Markdown 檔。沒有複雜的 class 定義,也沒有綁特定 framework。

這招很聰明:任何讀得懂 Markdown 的 AI 工具都能用。Claude Code、Cursor、Windsurf、Gemini CLI,統統都行。repo 還內建 agents/AGENTS.md 和 gemini-extension.json 做跨平台索引,讓 Codex 和 Gemini CLI 也能無痛接上。

對照 LangChain Tools 或 CrewAI Tools——那些是 Python 類別,用哪個框架就綁死。Apify 的做法是把「工具說明」壓平到 Markdown,讓 AI 自己判斷怎麼用。設計上更輕、耦合更低。

用在哪些場景最划算

潛在客戶開發:Google Maps scraper 抓「台北市牙醫診所」的名單,再串 Contact Info Scraper 補 email。人工一筆一筆查,一下午五十筆就手痠;AI 下指令三分鐘五百筆。

品牌監控:定期爬 Instagram hashtag 或 TikTok 關鍵字,追蹤品牌被提及次數和互動數。風向不對,早點知道。

競爭對手分析:競爭者的 Facebook 粉專貼文、廣告投放策略、Google Maps 評論,一次爬回來做比較分析。

網紅篩選:先用 Instagram/TikTok scraper 找到符合條件的網紅,再用 comment scraper 分析粉絲互動品質,過濾掉買粉帳號。

既有爬蟲上雲:手邊有台本機跑的 Python 爬蟲?丟給 Actorization skill,AI 會幫你加 async with Actor: 生命週期管理、寫 input schema、部署成 Apify Actor,變成可被 API 呼叫的雲端服務。

跟 LangChain Tools、CrewAI Tools 比較

| 比較 | Apify Agent Skills | LangChain Tools | CrewAI Tools |

|---|---|---|---|

| 本質 | Markdown 指令 + 腳本 | Python 類別 | Python 類別 |

| 框架耦合 | 無,任何 AI 都能用 | 綁定 LangChain | 綁定 CrewAI |

| 爬蟲能力 | 55+ 平台專業 Actor | 需自建 | 基礎 scrape 工具 |

| 執行環境 | Apify 雲端 | 本地 | 本地 |

| 費用 | 按結果筆數計費 | 免費(自付基礎設施) | 免費(自付基礎設施) |

| 入門門檻 | 零程式碼 | 要會 Python | 要會 Python |

什麼時候選 Apify Agent Skills:你用 Claude Code / Cursor 這類 AI 助手寫程式,爬蟲只是偶爾需要的工作,不想為了一次性需求去研究 Actor API。

什麼時候選 LangChain / CrewAI:你在寫一個需要精確流程控制的應用,每一步都要能介入、拼裝、除錯。那就不要走 Markdown 這層抽象,直接用 Python Tools。

踩坑注意

費用會爆。Apify 是付費服務,每次跑 Actor 消耗 credits,按結果筆數計費。預設上限 100 筆、超過 1000 筆 AI 會警告,但如果你不小心跑一個「爬 #taipei 全部貼文」這種沒邊界的任務,額度會被嚼光。

完全綁 Apify 平台。所有 skill 都走 Apify REST API,Apify Store 沒有你要的 Actor,就真的沒辦法。

不是程式庫。沒有 import 可以用,完全靠 AI 的理解能力執行。如果你想在傳統 Python 專案裡直接呼叫爬蟲功能,這條路走不通——要嘛 fallback 到 apify-client SDK,要嘛用 MCP server 接。

超時 600 秒。幾萬筆以上的大型爬蟲任務會撞到,要拆批或換成非同步 workflow。

法律風險自負。爬蟲受目標網站 Terms of Service 和 robots.txt 限制,特別是抓社群網站資料時,IG/FB/TikTok 的條款寫得很嚴。出事是自己扛。

這種模式可能改變什麼

回頭看這個 plugin,它跟 Stripe Minions、GitHub Copilot 的 Agent Skills 走的是同一條路:把「能力」打包成 Markdown 描述,讓 AI 自己去組合。

傳統軟體工具是工具 + 文件分離——你要自己讀文件、判斷什麼時候用哪個工具。AI 時代的工具正在反過來:文件就是介面,AI 是 dispatcher,你是 client。

想得極端一點:未來或許不會再有人背 API、讀 SDK 文件。你只要告訴 AI「我要做 X」,AI 自己從一堆 Markdown 能力包裡拼出解法。今天你能用一句中文爬遍 55 個平台——這只是開始。